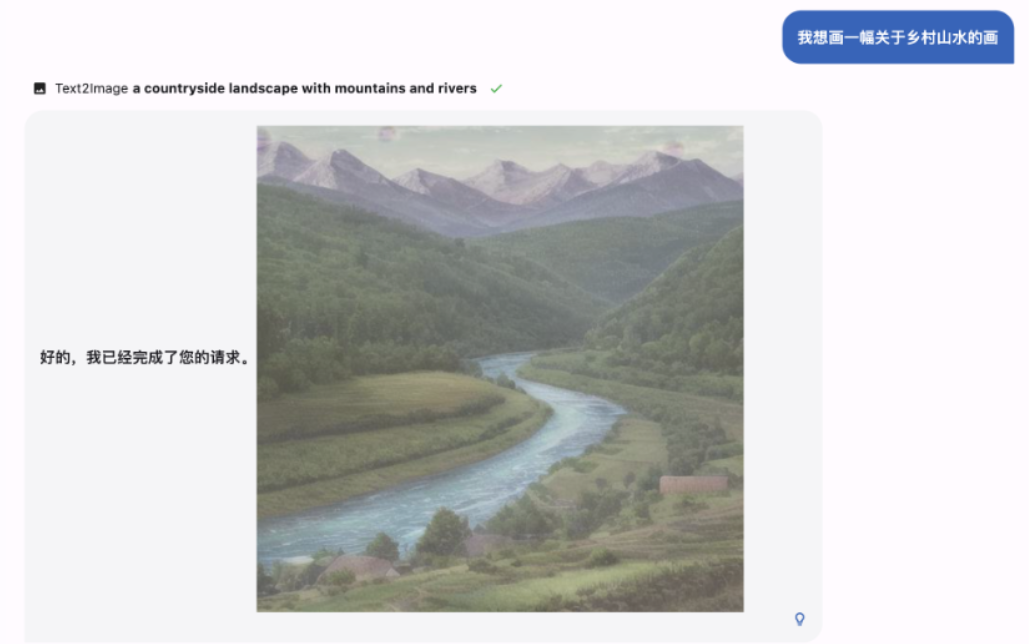

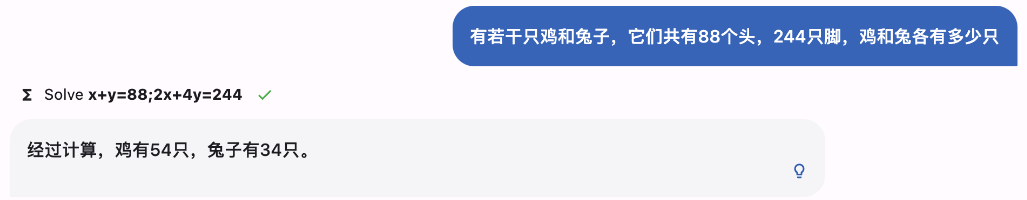

IT之家今日(4月21日)消息,复旦大学自然语言处理实验室开发的新版MOSS模型今日正式上线,成为国内首个插件增强的开源对话语言模型。

目前,MOSS模型已上线开源,相关代码、数据、模型参数已在Github和Hugging Face等平台开放,供科研人员下载。

据介绍,MOSS是一个支持中英双语和多种插件的开源对话语言模型,moss-moon系列模型具有160亿参数,在FP16精度下可在单张A100/A800或两张3090显卡运行,在INT4/8精度下可在单张3090显卡运行。MOSS基座语言模型在约七千亿中英文以及代码单词上预训练得到,后续经过对话指令微调、插件增强学习和人类偏好训练具备多轮对话能力及使用多种插件的能力。

MOSS来自复旦大学自然语言处理实验室的邱锡鹏教授团队,名字与《流浪地球》电影中的AI同名,已发布至公开平台(https://moss.fastnlp.top/),邀请公众参与内测。

据悉,该项目所含代码采用Apache2.0协议,数据采用CCBY-NC4.0协议,模型权重采用GNUAGPL3.0协议。如需将该项目所含模型用于商业用途或公开部署,需要签署文件并发送至robot@fudan.edu.cn取得授权,商用情况仅用于记录,不会收取任何费用。

MOSS的GitHub页面:点此查看