除了传言计划在今年的年度 I/O 活动中展示 20 多款由人工智能驱动的产品外,谷歌正在朝着构建支持 1,000 种不同语言的 AI 语言模型的目标迈进。在最近发布的更新中,谷歌分享了有关通用语音模型 (USM) 的更多信息,该系统被谷歌描述为实现其目标的“关键的第一步”。

去年 11 月,谷歌宣布计划创建一个支持 1,000 种世界上使用最常用的语言的语言模型,同时还展示其 USM 模型。谷歌将 USM 描述为“最先进的语音模型家族”,拥有 20 亿个参数,经过 1200 万小时的语音和 280 亿个句子的训练,涵盖 300 多种语言。

目前该模型已被用于谷歌旗下的 YouTube 用于生成字幕,它还支持自动语音识别(ASR)。它能自动检测和翻译语言,支持包括英语、中文普通话、阿姆哈拉语、宿雾语和阿萨姆语等。

目前,谷歌表示 USM 支持 100 多种语言,并将作为构建更广泛系统的“基础”。脸书公司 Meta 也正在开发一种类似的 AI 翻译工具,该工具仍处于早期阶段。

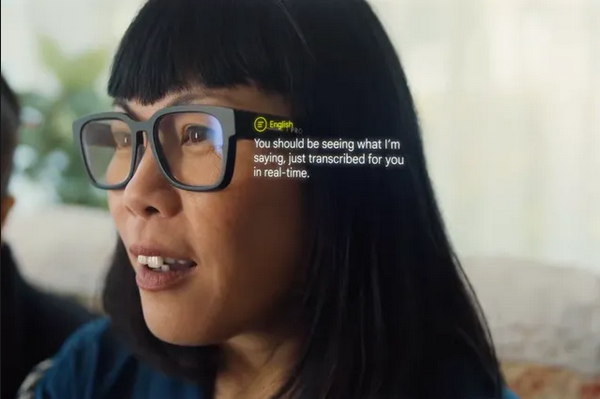

该技术的一个目标可能是将其用于在 AR 眼睛上进行实时翻译,在去年谷歌 I/O 活动展会上,谷歌也展示了这一功能。不过这一应用距离实际来到我们生活中似乎还要一段时间,首先 AR 或是智能眼镜的普及率依然非常低,同时在展会上翻译也在部分语言上出现了错误,可见该技术还不够成熟。